Problema este Sam Altman: Insiderii OpenAI nu au încredere în CEO

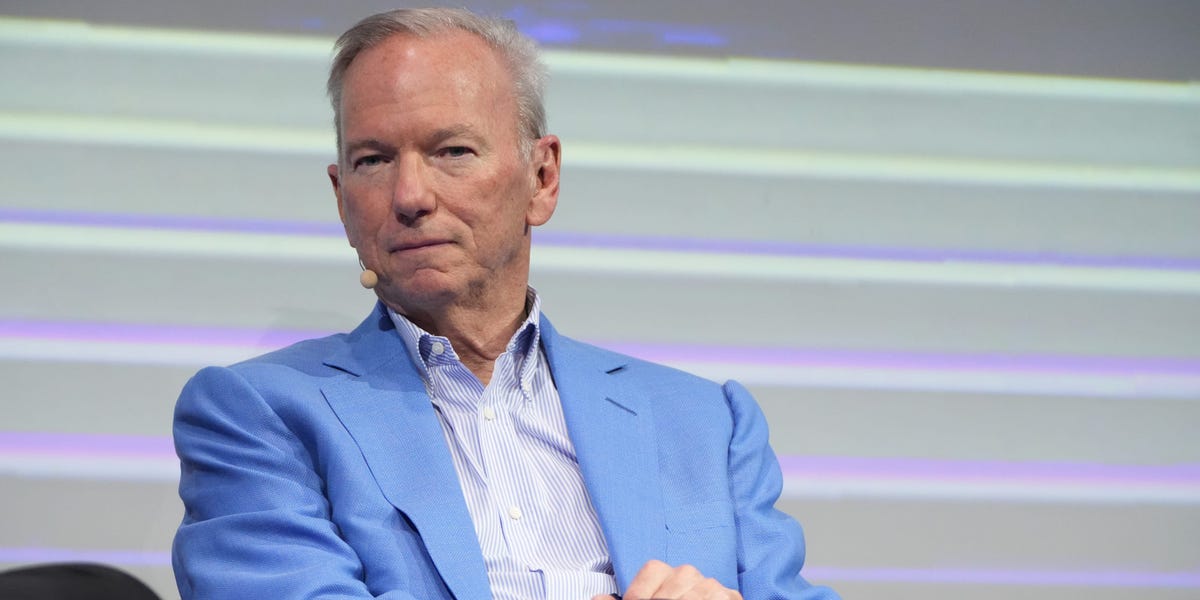

Un raport recent al The New Yorker pune la îndoială dacă CEO-ul OpenAI, Sam Altman, poate fi de încredere în îndeplinirea promisiunilor companiei, chiar în timp ce OpenAI lansează recomandări de politici pentru a asigura că inteligența artificială (IA) aduce beneficii umanității. Potrivit arstechnica.com, insiderii descriu un Altman care caută puterea și le spune altora ce vor să audă.

👉 Investigații interne și percepția angajaților asupra lui Altman

În aceeași zi în care OpenAI a publicat recomandări de politici pentru a se asigura că IA aduce beneficii umanității, The New Yorker a lansat o investigație extinsă asupra lui Sam Altman, întrebându-se dacă acesta poate fi de încredere în realizarea celor mai mari promisiuni ale OpenAI. Publicația a intervievat mai mult de 100 de persoane cunoscute cu modul de lucru al lui Altman și a revizuit memorii interne. Concluzia a fost că insiderii îl descriu pe Altman ca pe un om care caută approvalul, având „o dorință puternică de a-i face pe ceilalți să-l placă”, dar și un „lipsă aproape sociopatică de îngrijorare pentru consecințele înșelăciunilor”.

Deși The New Yorker nu a descoperit nicio „delict major”, reporterii au găsit dovezi de „înlănțuiri de înșelăciuni și manipulări” în mesajele foștilor cercetători șefi ai OpenAI, Ilya Sutskever și Dario Amodei. Indivizii au ajuns la concluzia că Altman nu a creat un mediu sigur pentru IA avansată. „Problema cu OpenAI”, a scris Amodei, „este Sam însuși”.

👉 Recomandări de politici și reacții publice

La rândul său, Altman a contestat afirmațiile din articol sau a spus că a uitat anumite evenimente, aducând ca explicație schimbările din peisajul IA. Totuși, contradicțiile sale devin din ce în ce mai greu de ignorat pe măsură ce investigațiile asupra OpenAI cresc.

Recent, OpenAI a adoptat un ton de „optimizm exuberant” în recomandările sale, care includ măsuri precum experimentarea cu săptămâni de lucru mai scurte și crearea unui fond public de bogăție pentru a împărtăși profiturile IA. În același timp, OpenAI a lansat un program pilot de burse și granturi de cercetare pentru a sprijini aceste politici. Cu toate acestea, The New Yorker sugerează că aceste inițiative ar putea fi un mijloc de distragere a atenției de la temerile publicului legate de securitate, șomaj și consumul de energie.

Un recent sondaj Harvard/MIT a arătat că cea mai mare îngrijorare a americanilor este că alimentarea IA va afecta calitatea vieții lor. Aceste temeri ar putea influența voturile în alegerile de la mijlocul mandatului, pe măsură ce moratoriile asupra centrelor de date câștigă sprijin.

OpenAI a promis că va dezvolta un „sistem de politică industrială pentru era inteligenței”, care să asigure accesul echitabil la IA. Printre propunerile sale se numără și implicarea lucrătorilor în discuții despre utilizarea sistemelor IA pentru îmbunătățirea productivității și siguranței la locul de muncă, precum și ideea de a impozita munca automatizată pentru a finanța programele sociale esențiale.

👉 Provocări și strategii pentru viitorul IA

Compania a recunoscut că toate aceste beneficii publice promise pot fi realizate doar prin construirea unei „societăți reziliente”. Altman a sugerat că firmele trebuie să dezvolte sisteme de siguranță și că nu ar trebui să interfereze decât atunci când există pericole reale.

OpenAI a subliniat că, în drum spre superinteligență, un număr restrâns de modele extrem de capabile necesită controale mai stricte. Totuși, criticile publicului deja existente ar putea face dificil pentru Altman și OpenAI să convingă lumea că au cele mai bune intenții.